Cognitive surrender maakt studenten dom!

U bevindt zich hier: Home ≫ Onderwijs ≫ cognitive offloading bouwt, cognitive surrender breekt af!

Luister naar deze blog op Spotify

Inleiding

Recent las ik een artikel van Bosman & Brongers (2026). Daarin vragen zij zich af of er in de toekomst nog wel werk is voor ICT-ers. Als reactie schreef ik er vanuit Frankrijk al een repost over op LinkedIn (met leesbaar artikel attached). Want vooral het gebruik van het begrip cognitive offloading schoot me als een graat in het verkeerde keelgat. Omdat dit steeds vaker gebeurt citeer ik uit hun artikel:

In gecontroleerde experimenten leerden developers een nieuwe programmeertechniek, de ene groep met AI-hulp, de andere zonder. De AI-groep was gemiddeld genomen niet sneller. Het eindeloze heen-en-weer met prompts, iteraties en validaties kostte vaak net zoveel tijd als ouderwets handwerk, maar scoorde wel 17% lager op cruciale vaardigheden zoals conceptueel begrip, code lezen en debuggen. Het probleem heet ‘cognitieve offloading’ (Bosman & Brongers, 2026, p. 64).

Maar dat is helemaal geen cognitive offloading!

Wat? Staat dat er echt? Is cognitive offloading een probleem? Dat was toch een fantastich concept (met benoemde risico’s)? Gaan we nu ineens een – ik zou bijna zeggen populistisch – probleem maken van zo’n genuanceerd begrip? Risko & Gilbert (2016) definieerden het namelijk als didactische strategie:

Het gebruik van fysieke handelingen of externe hulpmiddelen om de cognitieve eisen van een taak te verlagen.

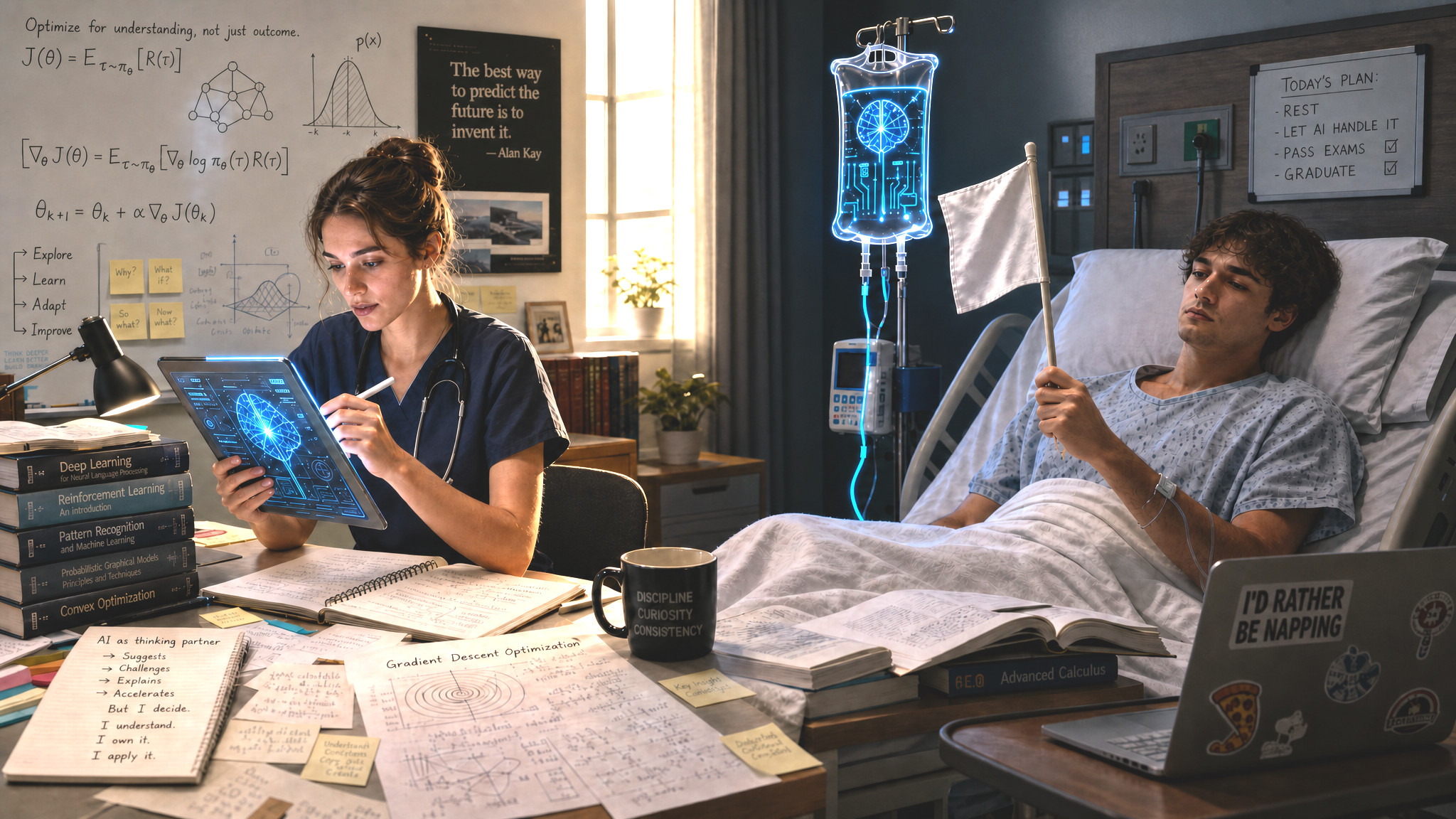

Natuurlijk: die risico’s zijn er. Maar dat gebeurt pas als we die handelingen/hulpmiddelen gebruiken om de cognitieve eisen van een taak te minimaliseren. En als de student daardoor stopt met leren of als leren een taakje wordt. Maar misbruik daarvoor dan niet het begrip cognitive offloading! Dat is onnodig. Want er bestaat al een term die 100% offloading veel beter dekt: cognitive surrender (The Economist, 2026). Bij cognitive surrender gaan studenten bij wijze van spreken aan het infuus van AI. En ze leveren zichzelf en bijna alles uit aan een machine. De witte vlag gaat omhoog en natuurlijk is dat een probleem! Want als zij AI op die manier gebruiken leidt dat tot verarming van de cognitieve vermogens van studenten. Zij worden daar substantieel dommer van! Inderdaad.

AI als bliksemafleider

Maar daarbij is AI niet het probleem! AI maakt alleen maar zichtbaar waar het probleem altijd al aanwezig was. Het zet de huidige onderwijspraktijk alleen maar in een ongenadig scherp licht waar we vandaag niet meer omheen kunnen. Want wanneer gebruiken studenten cognitive surrender? Hoewel zij dat begrip niet gebruiken, benoemen Gallant & Rettinger (2025) dat hardstikke scherp. Studenten kiezen voor cognitive surrender als het risico daarvan opweegt tegen wat het hen oplevert. En nog scherper: dat deden studenten altijd al; ook toen AI er nog niet was; alleen met andere hulpmiddelen!

Onjuist gebruik van AI wordt hier als bliksemafleider gebruikt. De receptie ervan is namelijk kenmerkend voor de maatschappelijke reflex bij de introductie van nieuwe technologie. Het is altijd zo geweest dat een samenleving kritiek had op technische innovaties (die ze daarna meestal omarmde). Neem nou de radio. Het verhaal gaat dat leraren begin 20ste eeuw de straat opgingen om te protesteren tegen de radio. Zij dachten dat zij daardoor hun werk kwijt zouden raken. Waarschijnlijk gaat het hierbij om een urban legend. Maar vandaag duikt het verhaal toch weer op in discussies over AI. En als je verder zoekt blijkt zo’n volksverhaal toch te corresponderen met een bestaande zorg (zoals ik bijvoorbeeld las op pagina 158 in het boek Radio and the Politics of Sound in Interwar France, 1921–1939 van Rebecca P. Scales; geraadpleegd op 14 mei 2026).

Didactisch verantwoord gebruik van AI bij cognitive offloading

Dat we AI zien als een probleem is het gevolg van een hyperfocus op de risico’s van cognitive offloading. Door de verwijzing naar “gecontroleerde experimenten” suggereren Bosman & Brongers dat die experimenten bewijzen dat AI gevaarlijk is. Maar de opzet van die experimenten is nogal suggestief. En de setting van deze experimenten lijkt erop gericht om aan te tonen dat gebruik van AI gevaarlijk is.

Voor mij zit de pijn van die experimenten in het feit dat ze inzoomen op een context zonder didactische aanpak. Studenten moeten een probleem oplossen en gebruiken daar wel of geen AI voor. Het is logisch dat we AI in die setting zien als een achteruitgang in vergelijking met het AI-loze tijdperk van voor 30 november 2022 (toen Open AI ChatGPT lanceerde). Studenten moeten het tot vandaag namelijk meestal nog steeds doen zonder didactische sturing van hun AI-gebruik. En ze kopiëren dus wat ze zien bij hun studiegenoten. Dat is ook leren, maar het levert hen een supoptimaal leerresultaat op en ze scoren “… 17% lager op cruciale vaardigheden zoals conceptueel begrip…”. Ja: dùh…

Dat is nou typisch het gevolg van cognitive surrender als uitvergroot risico van cognitive offloading. Want waar is het spectrum tussen die twee; tussen het zwart-witte gebruik van wel of geen AI? Waar is de aandacht voor het didactische concept waarbij studenten en docenten cognitive offloading als uitgangspunt gebruiken om met AI te leren werken? We gebruik(t)en toch ook didactische methodes om hen te leren programmeren? Waarom moeten studenten dan vandaag ineens met AI presteren alsof ze het ergens allang hebben geleerd?

Intermezzo: natuurlijk worden ICT-ers niet overbodig!

Op dit punt heb ik wel de beoefte om helder te zijn en misverstanden te voorkomen. Ik ben het namelijk eens met de kern van het betoog van Bosman & Brongers (2026)! ICT-ers worden niet overbodig! Echt niet! De mix van krapte in de arbeidsmarkt en steeds meer AI is een bedreiging voor BV Nederland. En dat bedoel ik deze keer eens niet negatief!

Tegelijkertijd zeg ik dat we die giftige mix ook wel een beetje aan onszelf te danken hebben. En het is mijn overtuiging dat we dat dus zelf ook moeten (en kunnen) repareren. In het onderwijs zijn we van nature inert. We denken namelijk dat het overdragen van traditie (tradere) de kern van ons vak is. Maar daarmee laten we studenten bij onvermijdelijke revoluties in de kou staan. AI stopt niet; in ieder geval niet vanzelf. Een zomer hou je ook niet tegen. Studenten hebben er in mijn ogen recht op dat wij vanuit didactisch perspectief met hen meedenken. Want ze kunnen AI wel degelijk verantwoord omarmen. Dat kan!

En zo kom ik terug bij de kern van mijn betoog. Cognitive surrender is een probleem en didactische verantwoorde cognitive offloading biedt een oplossing. Daarmee moeten we aan het werk en dat moeten we niet uitstellen tot morgen. De beeldvorming (dat ICT-ers geen toekomst hebben) hebben we deels aan onszelf te danken. Vraag maar eens aan collega’s (of aan willekeurige derden) hoe we in het onderwijs om moeten gaan met AI. Je krijgt van iedereen een ander antwoord. In het onderwijs worstelen we met dat dilemma. Zoals zo vaak veronachtzamen we de innoverende kracht van een deel van het werkveld. En we proberen het zonder hen op te lossen. Dat kan niet meer en dat moet anders.

Cognitive offloading is een fantastisch didactisch concept

In het huidige (gepolariseerde) debat over onderwijs en AI is de genuanceerde toon van de wetenschappelijke definitie van Risko & Gilbert (2016) vaak ver te zoeken. In het zwart-witte licht van die discussie verdwijnen subtiele verschillen naar de achtergrond. En voor je het weet verandert cognitive offloading van een kans in een probleem.

Volgens mij hoeft het niet zo zwart-wit. En de oplossing ligt – zoals vaker – voor het oprapen in het radicale midden. Barend Last is voor mij een belangrijke vertegenwoordiger van die beweging. Recent verwees Last (2026) waarderend en met een korte toelichting naar een rapport van Lodge & Loble (2026). Als je studenten wilt helpen bij het gebruik van AI, dan moet je dat inbedden in een didactische context. Dan moet je hen leren hoe ze AI succesvol kunnen gebruiken voor cognitive offloading.

Maar dat is toch logisch?

Maar – hoor ik je zeggen: dat is toch logisch? Natuurlijk spreekt dat vanzelf, maar bij technologische vernieuwing verliezen we dat uit het oog, omdat we vooral de dilemma’s zien. Voor het leren van een vak gebruik(t)en we toch ook didactisch verantwoorde methodes? Dan laat je die aanpak toch niet los als studenten leren om AI toe te passen in een specifieke context?

En wanneer kan cognitive offloading (met of zonder AI) daarbij succesvol worden ingezet? Heel kort door de bocht: als het de leerfunctie van een student bevordert. En als studenten zelfstandig leren om nog complexere problemen op te lossen. Maar cognitive offloading met AI gaat niet vanzelf. Dat heb je dus te leren en een eerste stap daarbij heet AI-literacy. Dat is de basis, want ook prompting gaat niet vanzelf goed. Nog vele malen uitvergroot geldt bij de toepassing van AI namelijk dat garbage in garbage out is. Maar wat is dan wel een goede prompt?

Tussentijdse balans over cognitive offloading

In een volgende paragraaf benoem ik een aantal didactische contouren van cognitive offloading. Maar eerst noem ik nog een aantal schrijvers die mij daarin in het verleden de weg hebben gewezen.

Barend Last

Barend Last verwijst (o.a. op LinkedIn) regelmatig naar wetenschappelijk onderzoek over de inzet van AI voor cognitive offloading. Kort samengevat komt zijn inbreng erop neer dat uit vooral empirisch onderzoek blijkt dat een didactische verantwoorde aanpak hoopgevende resultaten laat zien voor het gebruik van AI bij cognitive offloading. Studenten kunnen echt wel slimmer worden en complexere taken uitvoeren als zij AI gebruiken. Het is niet zo zwart-wit als sommigen ons willen laten geloven.

Wijze lessen

Hoewel het begrip er niet letterlijk in voorkomt ademt ‘Wijze lessen‘ toch cognitive offloading. Surma et al. (2019) noemen een aantal bouwstenen voor effectieve didactiek die uitgaan van een succesvolle toepassing van cognitive offloading. Zij gebruiken daarvoor concepten als het activeren van relevante voorkennis, scaffolding en spaced repetition. En zij wijzen op de verantwoordelijkheid die docenten daarbij hebben. Docenten hoeven zich in hun rol niet te laten marginaliseren. Ze mogen studenten namelijk actief wijzen op de kansen die cognitive offloading hen kan bieden. Tijdens de voorbereiding van hun onderwijs (in welke vorm dan ook) moeten ze die concepten dan wel actief gebruiken. En ze moeten het er transparant over hebben met hun studenten.

Barbara Oakley

En vergeet Oakley (2014) niet. Zij maakte een online cursus voor studenten over wat zij kunnen leren van de resultaten van cognitief onderzoek. En zij schreef meerdere boeken (waarvan Oakley (2014) de belangrijkste is) voor zowel studenten als voor docenten. Hoewel de term niet centraal staat, ademt ook haar boek cognitive offloading en gaat het er vanuit. Zie ook mijn blog over ‘A Mind for Numbers’ van Barbara Oakley en procrastination.

Tricia B. Gallant & David A. Rettinger

Maar laten we inderdaad niet over het hoofd zien dat de toepassing van cognitive offloading ook risico’s met zich meebrengt. Dat vraagt om inzet op formatief handelen (met de focus op het proces van het leren). En studenten moeten zich mondelinge verantwoorden voor opgeleverd werk en uitgevoerde taken. Gallant & Rettinger (2025) tonen aan waarom we dat al veel eerder hadden moeten doen. En zij geven praktische tips om dat te realiseren.

Cognitive offloading als didactische strategie

Terug naar mijn stelling: cognitive surrender is een probleem en didactische verantwoorde cognitive offloading biedt een oplossing. Maar aan welke didactische voorwaarden zou cognitive offloading moeten voldoen om bij te dragen aan het effectieve leerproces dat studenten doorlopen; ook als ze AI gebruiken?

Richard Sennett en het begrip respect

Dat begint bij respect. Als we de eigen keuzes van onze studenten ondersteunen, kunnen zij een eigen professionele identiteit ontdekken en ontwikkelen. In hun levensfase zijn ze nog op zoek. Maar niemand kent hen beter dan dat zij zichzelf kennen. Zie mijn blog over het boek ‘Respect in een tijd van sociale ongelijkheid’ van Richard Sennett.

Deci & Ryan en het begrip intrinsieke motivatie

Autonomie is onderdeel van het ABC van intrinsieke motivatie zoals Deci & Ryan die formuleren: Autonomie, verBondenheid en Competentie. Door ons te verbinden met het leven van onze studenten en hun identiteit, door hen te respecteren in hun keuzes en door hen uit te dagen om uit te blinken, stimuleren we hen om intrinsiek gemotiveerd te leren. Zie mijn blog over het boek ‘Is het voor het cijfer?’ van Johannes Visser.

Gert Biesta en de pedagogische opdracht

In het onderwijs zijn we niet alleen verantwoordelijk voor de kwalificatie van onze studenten. We dragen immers ook bij aan hun socialisatie? Bovendien leven we hen subjectificatie voor! Zie mijn blog over het boek ‘Het prachtige risico van onderwijs’ van Gert Biesta.

Wij hoeven niet in te schatten wat hun potentie is. Dat zou hun ongelijkheid vergroten. Het legt de focus bij prestatie. En lol legt daarbij het loodje. Wel mogen we uitdagen. Daarbij gaan we uit van hun unieke leerverhouding tussen nature en nurture. En we roepen hen ter verantwoording voor hun keuzes. Docenten helpen niet om te ontdekken wat al beschikbaar is. Maar ze provoceren hun studenten (a la Heidegger) om te voorschijn te roepen wat er nu nog niet is. Zie mijn post op LinkedIn over het nieuwste essay van Gert Biesta: ‘Is daar iemand? Gelijke kansen en de vergeten pedagogische opdracht van de school’).

Nuthall en zijn Hidden Lives of Learners

Studenten leren tijdens de levensfase waarin zij een voltijdstudie beginnen vooral van hun peers. Docenten vervullen een veel kleinere rol dan zij zelf denken. Bovendien blijft veel van wat studenten denken en leren onzichtbaar voor docenten. Daar hebben we rekening mee te houden in de didactische opzet van ons onderwijs. Zie mijn blog over het boek ‘The Hidden Lives of Learners‘ van Graham Nuthall).

Cognitive offloading heeft een didactische context nodig

Voor mij komt cognitive offloading niet tot z’n recht zonder die didactische context. Voor Risko & Gilbert (2016) is Cognitive offloading een middel om “de cognitieve eisen van een taak te verlagen”. Dat gaat ervan uit dat je werkgeheugen een beperkte capaciteit heeft (Oakley, 2014. pp. 42) en cognitive offloading kan helpen om ruimte vrij te maken voor nieuwe ideeën; voor vernieuwing.

Voordat studenten cognitive offloading met AI effectief als metacognitieve strategie in kunnen zetten, gaat daar een cognitieve fase aan vooraf. Cognitive ofloading kun je namelijk leren; heb je te leren en dat gaat niet vanzelf. Cognitive offloading heeft dus een didactische context nodig. En voor mij zouden de concepten van Deci & Ryan, Biesta, Nuthall en anderen daar een plek in moeten hebben. En natuurlijk zou dat onderwijs evidence based ontwikkeld moeten worden. Of we zouden dat onderwijs verder empirisch moeten onderzoeken.

De ontwikkeling van een professionele identiteit

In de ondertitel van zijn meest recente essay spreekt Gert Biesta over een pedagogische opdracht van de school. De opdracht van het onderwijs gaat verder dan didactiek. We mogen studenten van hem meer uitdagen om zich te ontwikkelen tot een volwassen zelf dat past bij hun levensfase. Dat doen docenten niet door uit te gaan van hun nature. Zij hoeven de potentie van hun studenten niet te beoordelen. Integendeel: zij mogen hen in een situatie van nurture verantwoord provoceren (letterlijk vanuit de Latijnse bron als tevoorschijn roepen). Ze mogen met ons buiten hun comfort zone (in de zone van nabije ontwikkeling) verder groeien. En docenten mogen hun studenten voorleven wat het betekent om aanspreekbaar te zijn. Elders gebruikt Biesta hiervoor de termen socialisatie en subjectificatie.

Manon Ruijters noemt dat in haar ‘Mijn binnenste buiten’ (2019) het ontdekken en aannemen van een professionele identiteit. In andere woorden drukken Biesta en Ruijters mijns inziens hetzelfde uit. Als je wilt leren en leven, moet je weten wie je bent (nature) en wie je worden wilt (nurture). En voor mij is die levensfase onlosmakelijk verbonden met ethiek. En die komt ten diepste neer op de vraag of alles wat kan ook moet.

De pedagogische opdracht

En dat is mijns inziens de belangrijkste pedagogische opdracht van het onderwijs. Tijdens een recent event bij De Haagse Hogeschool stelde een studente de slimme vraag of er ook een soort van ‘vegetarische’ AI bestaat. Felienne Hermans moest er even een korte denkpauze voor nemen. Maar ze antwoordde zonder daarna nog te twijfelen dat vegetarische AI in overdrachtelijke zin zeker bestaat. Net als vegetarische voeding heeft ‘vegetarische’ AI echter minder bite dan de AI die tech bro’s ons voorschotelen. De fundamentele vraag is dan ook niet of we AI moeten gebruiken (ook een zomer hou je immers niet tegen).

Onderdeel van haar antwoord was dat we ons bij elke actie een fundamentele vraag moeten stellen. Weegt de specifieke inzet van bijvoorbeeld AI op tegen al de nadelen die mainstream AI óók heeft? Roxanne van Iperen (‘Ik zie wat ik geloof‘, 2026) en Marietje Schaake (‘De machtscode‘, 2026) schrijven daarover. Zij schetsen de fundamentele impact van mainstream AI op gemeenschappen en op onze democratie. Als je dat gelezen hebt kun je niet meer zeggen dass wir es nicht gewusst haben. Maar niemand komt vanzelf in aanraking met die vragen. Als docent heb ik de pedagogische opdracht om hen te provoceren. Ik mag hen uitdagen om die ethische overwegingen mee te wegen in de keuze voor hun professionele identiteit.

De ethische impact van mainstream AI

En natuurlijk hebben we in ons onderwijs met die pedagogisch-ethische opdracht naadloos aan te sluiten bij de hierboven geschetste didactische context. Maar pedagogische ethiek gaat verder dan didactiek. Bij didactiek gaat het over het faciliteren van een leerproces; over hoe studenten optimaal leren. Bij pedagogiek gaat het over het provoceren van studenten. Hoe kunnen zij boven hun eigen nature uitstijgen en een eigen professionele identiteit ontwikkelen? Daarin mag ethische opvoeding niet ontbreken.

Want macht corrumpeert (lees de vreselijk herkenbare toneelstukken van Sartre er nog maar eens op na). De afgelopen decennia heeft macht zich in de handen van steeds minder tech bro’s geconcentreerd. En dat bedreigt onze democratie (zoals ook nog eens blijkt uit onderzoek van OXFAM Novib).

Onze ongeneeslijke overlevingsreflex is om ons daaraan te conformeren, maar dat hoeft niet. En dat is precies de pedagogisch-ethische opdracht waarover Biesta het heeft. Want is AI de meest geschikte partij aan wie ik mijn vraag moet stellen (als je alle perspectieven meeweegt)? Hoe hoog zijn die werkelijke kosten van AI nou echt ? Voor een aanzet verwijs ik naar mijn blog over AI uit 2023. Hoewel ik er meteen bij zeg dat daar ondertussen wel wat op aan te merken valt. Kan ik deze vraag misschien ook anders beantwoorden? In hoeverre laat ik in mijn overwegingen de lange termijn meetellen? En mag de korte termijn van mijn belangen opwegen tegen de lange termijn die voorbijgaat aan mijn generatie?

De pedagogisch-ethische opdracht voor het onderwijs

Dat zijn vragen die we niet vanzelf stellen; die we moeten leren stellen. En het onderwijs is de ideale zandbak waarin we daarmee samen met studenten kunnen oefenen. Niet wij hebben de waarheid in pacht. Maar we mogen samen met hen leren om kritisch en onderzoekend met deze vragen bezig te zijn.

En daarmee zijn we opnieuw terug bij onze stelling. Cognitive surrender helpt onze studenten niet om die vragen te beantwoorden. AI nodigt namelijk uit tot Zero Google: na het eerste antwoord zoeken we niet meer verder. Cognitive offloading kunnen we daarentegen strategisch inzetten om ruimte te (laten) scheppen. Zo kunnen studenten aan die ethische vragen (en nog aan heel veel meer) voorbij leren denken. En wij kunnen ze leren hoe ze die vaardigheid ontwikkelen. Want hoe doe je dat? Hoe betrek je ethische vragen bij de vorming van je professionele identiteit?

Een filosofische onderlegger

Vorig jaar schreef ik een kort artikel over AI en zelfreflectie (Van der Lelij, 2025). na een gerichte zoektocht in Heideggers Die Frage nach der Technik vatte ik het begrip cognitive surrender (zonder het te noemen) toen als volgt samen:

In hoeverre accepteert u (als student) dat een technologie voor u bepaalt wat u doet en moet laten? Want het grootste gevaar daarvan is dat u van co-regulatie verzandt in AI die uw leren reguleert. En waar blijft u als AI zelfreflectie van u overneemt? En wie bent u dan nog?

In zijn boek Waarom vragen wij? refereert Erik Oevermans (2025) aan dezelfde tekst van Heidegger. In zijn hoofdstuk over het begrip overvragen (pp. 118-134) schrijft hij over het woord Bestand dat Heidegger hiervoor gebruikt. De moderne techniek dringt ons een wereld op die beschikbaar is. Als je de kraan opendraait, komt er water uit. Als je een lampje aanzet, brandt het. Die beschikbaarheid (de wereld als Bestand) wordt als een deken over onze samenleving heen gelegd. En dat leidt er toe dat niet alleen de dingen (en gebeurtenissen) om ons heen beschikbaar zijn. Ook wij dreigen onszelf op die manier beschikbaar te maken voor anderen. Wij overvragen de wereld als Bestand en overvragen daarmee anderen en onszelf.

Schaake (zie hierboven, pp. 76-80) laat zien dat AI de grenzen van die beschikbaarheid zichtbaar maakt. Netcongestie en kostbaar drinkwater stromen naar datacenters en gaan bij schaarste ten koste van de beschikbaarheid voor consumenten en andere bedrijven. En souvereiniteit wordt opgeofferd voor de bevrediging van onze behoeften op korte termijn (pp. 133-136). Daar moeten we onszelf – en onze studenten – bewust van maken. Want het kan anders. Dat Bestand ís geen zomer die we niet tegen kunnen houden. Ja: de lange termijn vraagt om ingrijpende keuzes, maar die kunnen we nu (nog) maken!

Nieuwsgierigheid naar het andere; naar de ander

De pedagogisch-ethische opdracht vraagt om filosofische verdieping. Zonder verdieping blijft bewustwording achterwege. Zonder ethische bezinning, kunnen studenten hun bewuste keuzes niet (leren) onderbouwen. Nu kan het nog!

Biesta (2026, pp. 41-50) heeft het daarbij over geroepen zijn. Oevermans (pp. 135-158) spreekt over aanvragen (met de aan van aanspreken). Daar hoort nieuwsgierigheid bij als willen weten wat anders is; wie de ander is. Leren kan niet bestaan zonder nieuwsgierigheid naar de ander en het andere; zou ik zeggen. Daarbij hoeven we die filosofische onderlegger van Levinas, Buber en Rosenstock-Huessy echt niet expliciet te maken. Maar het begrip subjectificatie dat Biesta hiervoor gebruikt mag meer aandacht krijgen. En dat mag vooral handen en voeten krijgen als docenten voorleven hoe dat werkt. Wij mogen studenten daarmee provoceren om een zelf te ontwikkelen dat zich bewust verhoudt tot de ander. Nieuwsgierigheid naar al dat andere stimuleert ons allen om aan nature voorbij te leven in de context van nurture.

Bij wijze van conclusie: Cognitive offloading is een fantastisch didactisch concept!

Ik vat samen. Het populistische gebruik van het begrip cognitive offloading als probleem krijgt van mij een rode kaart. Studenten hoeven niet dom te worden als ze AI gebruiken. Dat gebeurt alleen als ze aan 100% ofloading meewerken. Maar dan is er dus geen sprake van meer van cognitive offloading, maar hebben we het over cognitive surrender.

Ik stel voor dat we in ieder geval stoppen met AI te gebruiken als bliksemafleider. Want als we cognitive offloading met AI gebruiken als didactisch onderbouwde strategie, ontwikkelen we toekomstbestendig onderwijs. Zulk onderwijs kan weer tegen een stootje en het kan studenten slimmer maken dan ze nu al zijn.

Daarvoor is samenwerking met een werkveld met innovatieve slagkracht onvermijdelijk en noodzakelijk. En studenten hebben daar recht op: dat wij hen niet alleen een vak leren. Zij verlangen ernaar dat wij hen voorleven hoe zij zich voor kunnen bereiden op een positie in de samenleving. Tijdens hun adolescentie kunnen ze dat oefenen. Pas in de context van een eigen beroepspraktijk zullen zij ten volle tot hun recht komen. Daar willen zij aanspreekbaar zijn op hun professionele inbreng. Maar nu weten ze nog niet precies hoe dat werkt. En precies daar scheppen wij de didactische nurture om zich te kunnen ontwikkelen tot wie ze willen zijn.

Vandaag nog aan het werk met cognitive offloading, zou ik zeggen.

P.S.: bovenstaande tekst heb ik zelf geschreven, maar in de verkennende fase heb ik beperkt gebruik gemaakt van cognitive offloading. Daarbij heb ik geprofiteerd van de LLM van abacus.ai om wat zaken voor me op een rij te zetten. Ook de afbeelding boven de tekst is natuurlijk geen echte foto. Het plaatje is namelijk gegenereerd op basis van een prompt waarin ik de metaforen meegaf en GPT Image 2 de ‘foto’ voor me maakte.

Literatuur

Bosman, A. & Brongers, K. (2026). Meer AI, minder instroom is een gevaarlijke combinatie: Is de ICT-professional nog nodig in het AI-tijdperk? AG Connect, 2, 62–65. Als eigen repost met comments geraadpleegd op 5 mei 2026, van https://www.linkedin.com/posts/kadmosb_minder-hbo-ict-instroom-door-ai-activity-7457072540213993472-zqRC?utm_source=share&utm_medium=member_desktop&rcm=ACoAAAAY95wB9XS0fGmQ3iX5vAT6f5SyVphHTuQ.

Gallant, T. B. & Rettinger, D. A. (2025). The Opposite of Cheating: Teaching for Integrity in the Age of AI. University of Oklahoma Press.

Last, B. (2026, 13 maart). Als je dit jaar één rapport leest over AI en onderwijs, lees dan onderstaande publicatie van top tot teen. LinkedIn. Geraadpleegd op 5 mei 2026, van https://www.linkedin.com/posts/barendlast_rapport-cognitive-offloading-ugcPost-7437767004318683136-MXW9?utm_source=share&utm_medium=member_ios&rcm=ACoAAAAY95wB9XS0fGmQ3iX5vAT6f5SyVphHTuQ.

Lodge, J. M. & Loble, L. (2026). Artificial intelligence, cognitive offloading and implications for education. In UTS Figshare. Geraadpleegd op 5 mei 2026, van https://doi.org/10.71741/4pyxmbnjaq.31302475.

Risko E. & Gilbert S.J. (2016). Cognitive Offloading. In Trends in Cognitive Sciences, 20, 676-688. Geraadpleegd op 5 mei 2026, van https://doi.org/10.1016/j.tics.2016.07.002.

Surma, T., Vanhoyweghen, K., Sluijsmans, D. M. A., Camp, G., Muijs, D. & Kirschner, P. A. (2019). Wijze lessen: twaalf bouwstenen voor effectieve didactiek. Ten Brink Uitgevers. Geraadpleegd op 5 mei 2026, van https://www.ou.nl/documents/846784/0/Wijze_Lessen_digitaal_160919.pdf/53ce9ca8-c213-ebc6-d674-ac24f78596ef.

Oakley, Barbara (2014). A Mind for Nimbers, How to Excel at Math and Science (Even if You Flunked Algebra). TarcherPerigee.

The Economist (2026). AI and the danger of cognitive surrender. In The Economist, 30 april 2026. Geraadpleegd op 14 mei 2026 van https://www.economist.com/business/2026/04/30/ai-and-the-danger-of-cognitive-surrender.

Van der Lelij, K. J. (2025). Zelfreflectie geautomatiseerd: Een korte handleiding tot zelfvervreemding. In Karikatuur, Lustrumbundel ter ere van het 75-jarig bestaan van dispuut Johannes Calvijn, uitgaande van de C.S.F.R. (pp. 37–39). ComposiCie, XVe LustrumCie der C.S.F.R. Delft. https://lelij.com/files/Artikel ‘AI in de ban van zelfreflectie’.pdf.

Vorig bericht

Vorig bericht